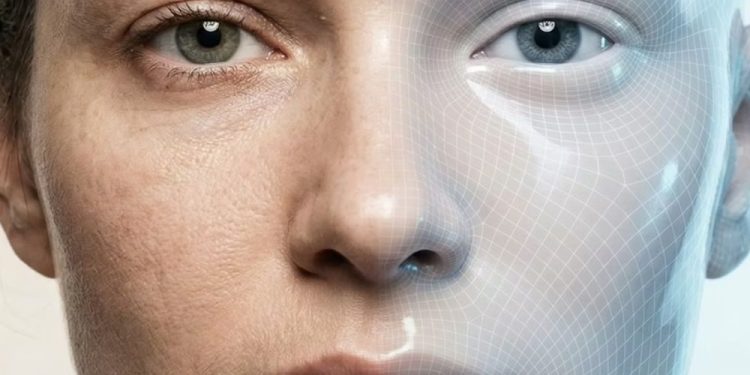

La llegada de herramientas de IA baratas, accesibles y de gran capacidad, ha permitido manipular contenido digital de audio, vídeo e imagen de una manera desconocida hasta la fecha. El fenómeno solo acaba de empezar y algunos investigadores están alertando de un aumento exponencial de su capacidad, volumen y potencial para ciberataques. Simplemente, los deepfakes de 2026 harán imposible distinguir la realidad de la ficción.

Los deepfakes fueron -junto al ransomware- los principales ciberataques de 2024 y este año han «mejorado» distribuido. Los rostros, voces y representaciones de cuerpo entero generados por IA que imitan a personas reales aumentan en calidad mucho más allá de lo que los expertos podían esperar. Además, se utilizaron cada vez más para engañar a los usuarios.

En muchas situaciones cotidianas, especialmente en videollamadas de baja resolución y contenido multimedia compartido en redes sociales, su realismo es ahora lo suficientemente alto como para engañar con confiabilidad a espectadores inexpertos. En la práctica, los medios sintéticos se han vuelto indistinguibles de las grabaciones auténticas. para la gente común y, en algunos casos, incluso para empresas e instituciones.

Este aumento no se limita a la calidad de los desarrollos. El volumen de deepfakes ha crecido exponencialmente: la firma de ciberseguridad Golpe profundo estima que desde los aproximadamente 500.000 deepfakes en línea en 2023 se ha pasado a unos 8 millones en 2025, con un crecimiento anual cercano al 900%. Frente a ellos y a pesar de los informes que resaltar la amenaza que la IA generativa supone para la realidad digital y las propuestas de marcos de defensa multicapa, muy poco se ha avanzado.

Uno de los autores del informe, profesor de Ciencias de la Computación y Director del Laboratorio Forense de Medios en la Universidad de Buffalo, ha publicado un análisis de situación donde adelanta un año próximo terrible donde la mayoría no será capaz de distinguir el contenido legítimo.

«Mejoras» espectaculares en Deepfakes

Varios cambios técnicos subyacen a esta drástica escalada. En primer lugar, el realismo del vídeo dio un salto significativo gracias a los modelos de generación de video diseñados específicamente para mantener la consistencia temporal. Estos modelos producen vídeos con movimiento coherente, identidades consistentes de las personas retratadas y contenido coherente de un fotograma a otro. Los modelos separan la información relacionada con la representación de la identidad de una persona de la información sobre el movimiento, de modo que un mismo movimiento puede asignarse a diferentes identidades. O una misma identidad puede tener múltiples tipos de movimientos.

Estos modelos producen rostros estables y coherentes sin parpadeos, deformaciones ni distorsiones estructurales alrededor de los ojos y la mandíbula que alguna vez sirvieron como evidencia forense confiable de los deepfakes.

En segundo lugar, la clonacion de voz ha traspasado lo que el experto llama el «umbral indistinguible». Unos pocos segundos de audio bastan ahora para generar una clonación convincente, con entonación, ritmo, énfasis, emoción, pausas y ruido de respiración natural. Esta capacidad ya está fomentando el fraude a gran escala. Algunos grandes minoristas informan recibir más de 1000 llamadas fraudulentas generadas por IA al día. Los indicios perceptivos que antes delataban las voces sintéticas han desaparecido prácticamente.

En tercer lugar, las herramientas para el consumidor han reducido la barrera técnica prácticamente a cero. La llegada de aplicaciones de IA mejoradas como el Sora 2 de OpenAI o el Veo 3 de Google, junto con una oleada de startups, permiten que cualquiera pueda describir una idea, dejar que un modelo de lenguaje extenso como ChatGPT de OpenAI o Gemini de Google redacte un guion y genere contenido audiovisual de alta calidad en minutos. Los agentes de IA pueden automatizar todo el proceso. La capacidad de generar deepfakes coherentes y basados en argumentos a gran escala se ha democratizado de forma efectiva.

Esta combinación de cantidad creciente y personajes casi indistinguibles de los humanos reales crea serios desafíos para la detección de deepfakes, especialmente en un entorno mediático donde la atención de la gente está fragmentada y el contenido se difunde a mayor velocidad de la que puede verificarse. Y son numerosos los informes de daños reales: desinformación, acoso, estafas financieras y casi cualquier ciberataqueuna vez que los deepfakes por IA han dejado de ser una función teórica y se han convertido en una «solución» explotable en el mundo real que mina la confianza digital, exponen a las empresas a nuevos riesgos e impulsa el negocio comercial de los ciberdelincuentes.

Deepfakes de 2026: indistinguibles y en tiempo real

El investigador avanza un futuro donde los deepfakes avanzan hacia la síntesis en tiempo realcapaces de producir vídeos que se asemejarán a los matices de la apariencia humana, lo que facilitará su evasión de los sistemas de detección. La frontera se está desplazando del realismo visual estático a la coherencia temporal y conductual: modelos que generan contenido en directo o casi en directo en lugar de clips pre-renderizados.

El modelado de identidad está convergendo en sistemas unificados que capturan no solo la apariencia de una persona, sino también cómo se mueve, suena y habla en distintos contextos. El resultado se encamina desde «esto se parece a la persona X» a «esto se comporta como la persona X con el tiempo».

A medida de que estas capacidades maduren, la brecha perceptual entre los medios humanos sintéticos y auténticos seguirá reduciéndose. La línea de defensa significativa se alejará del juicio humano. En su lugar, dependerá de protecciones al nivel de infraestructura. Estos incluyen la procedencia segura, como medios firmados criptográficamente, y herramientas de contenido de IA que utilizan estándares abiertos como el propuesto por la Coalición para la Procedencia y Autenticidad del Contenido.

«Simplemente mirar con más atención los píxeles ya no será suficiente»concluye el experto forense.