Una desinformación pro-Rusia La campaña está aprovechando las herramientas de inteligencia artificial del consumidor para alimentar una «explosión de contenido» centrada en exacerbar las tensiones existentes en torno a las elecciones globales, Ucrania y la inmigración, entre otros temas controvertidos, según nueva investigación publicada la semana pasada.

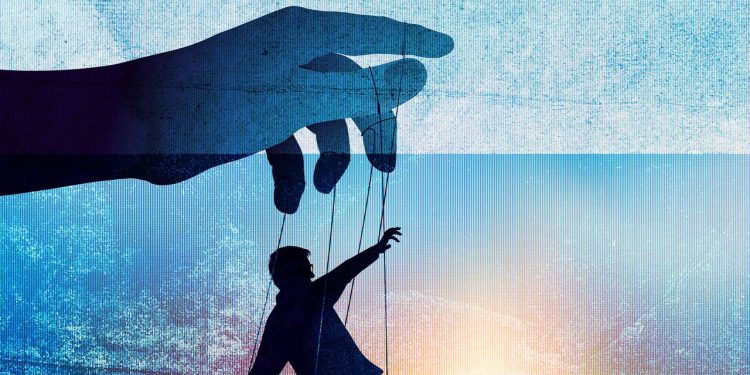

La campaña, conocida por muchos nombres, incluidos Operación sobrecarga y Matryoshka (Otros investigadores también lo han vinculado a Tormenta-1679), ha estado operando desde 2023 y ha sido alineado con el gobierno ruso por múltiples grupos, incluidos Microsoft y el Instituto de Diálogo Estratégico. La campaña difunde narraciones falsas al hacerse pasar por los medios de comunicación con el objetivo aparente de sembrar la división en los países democráticos. Mientras que la campaña se dirige al público en todo el mundo, Incluyendo en los Estados Unidossu objetivo principal ha sido Ucrania. Cientos de videos manipulados por AI de la campaña han tratado de alimentar las narrativas pro-rusas.

El informe describe cómo, entre septiembre de 2024 y mayo de 2025, la cantidad de contenido producido por quienes dirigen la campaña ha aumentado dramáticamente y está recibiendo millones de opiniones en todo el mundo.

En su informe, los investigadores identificaron 230 piezas únicas de contenido promovidas por la campaña entre julio de 2023 y junio de 2024, incluidas imágenes, videos, códigos QR y sitios web falsos. Sin embargo, en los últimos ocho meses, la operación sobrecarga produció un total de 587 piezas de contenido únicas, y la mayoría de ellos se crearon con la ayuda de herramientas de IA, dijeron los investigadores.

Los investigadores dijeron que el aumento en el contenido fue impulsado por herramientas de IA de grado consumidor que están disponibles de forma gratuita en línea. Este fácil acceso ayudó a impulsar la táctica de la campaña de «amalgamación de contenido», donde aquellos que dirigían la operación pudieron producir múltiples piezas de contenido que empujan la misma historia gracias a las herramientas de IA.

«Esto marca un cambio hacia tácticas de propaganda más escalables, multilingües y cada vez más sofisticadas», escribieron en el informe los investigadores de RESET Tech, una organización sin fines de lucro con sede en Londres que rastrea las campañas de desinformación y verifica primero una compañía de software finlandesa. «La campaña ha ampliado sustancialmente la producción de nuevo contenido en los últimos ocho meses, lo que indica un cambio hacia métodos de creación de contenido más rápidos y escalables».

Los investigadores también se sorprendieron por la variedad de herramientas y tipos de contenido que la campaña estaba siguiendo. «Lo que me sorprendió fue la diversidad del contenido, los diferentes tipos de contenido que comenzaron a usar», dijo Aleksandra Atanasova, investigador de inteligencia de código abierto en RESET Tech, a Wired. «Es como si hubieran diversificado su paleta para atrapar tantos ángulos como diferentes de esas historias. Están capacitando diferentes tipos de contenido, uno tras otro».

Atanasova agregó que la campaña no parecía estar utilizando herramientas de IA personalizadas para lograr sus objetivos, sino que estaban utilizando generadores de voz e imágenes con AI a los que se puede acceder a todos.

Si bien era difícil identificar todas las herramientas que los agentes de campaña estaban utilizando, los investigadores pudieron reducir a una herramienta en particular: Flux AI.

Flux AI es un generador de texto a imagen desarrollado por Black Forest Labs, una compañía alemana fundada por ex empleados de Stability AI. Utilizando la herramienta de análisis de imágenes de SightEngine, los investigadores encontraron una probabilidad del 99 por ciento de que varias imágenes falsas compartidas por la campaña de sobrecarga, algunas afirmaron mostrar a los migrantes musulmanes disturbios y incendios en Berlín y París, se crearon utilizando la generación de imágenes de Flux AI.