Noticias

Una nueva herramienta de inteligencia artificial (IA) puede pronosticar el riesgo de una persona de desarrollar más de 1,000 enfermedades. El modelo, llamado Delphi-2m, utiliza los registros de salud de una persona y los factores de estilo de vida para Estima su probabilidad de desarrollar enfermedades como el cáncer y las condiciones inmunes hasta 20 años antes de tiempo. Para muchas enfermedades, las predicciones de Delphi-2M coincidieron o excedieron la precisión de los de los modelos actuales que estiman el riesgo de desarrollar una sola enfermedad. «Funcionó asombrosamente bien», dice el científico y coautor del estudio de Data Moritz Gerstung.

Referencia: Naturaleza papel

Noticias

Deepseek-R1, un modelo de 'razonamiento' barato y poderoso de inteligencia artificial (AI) que envió la espiral de la espiral de los Estados Unidos después de que fue liberado por una empresa china en enero, costó solo US $ 300,000 para entrenar. Ese es uno de los Revelaciones en un nuevo artículo del equipo Deepseek -haciendo de R1 el primer LLM importante para someterse al proceso de revisión por pares.

Referencia: Naturaleza papel

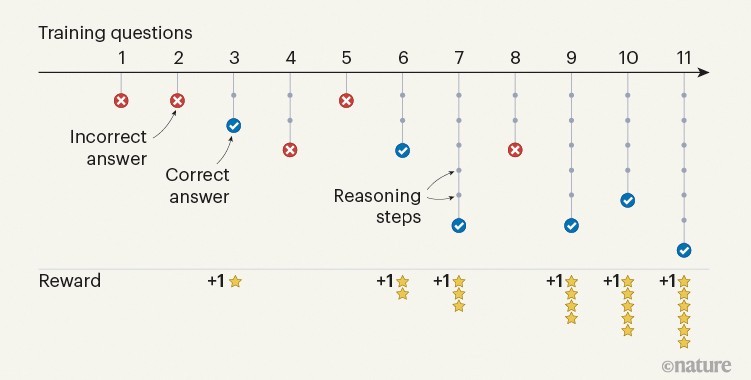

El equipo detrás de Deepseek-R1 mostró que se puede enseñar un modelo de lenguaje grande a «razonar» sin ver un ejemplo de razonamiento humano. Para hacerlo, utilizaron una técnica llamada aprendizaje de refuerzo, en la que el modelo fue recompensado por la respuesta correcta a las preguntas matemáticas y penalizado por respuestas incorrectas. El modelo pronto aprendió que el razonamiento mejoró la probabilidad de encontrar la respuesta correcta, y desarrolló la capacidad de autorreflexionar y corregirse antes de generar una respuesta. (Naturaleza Noticias y puntos de vista | 7 min Read)

Noticias

Una preimpresión reciente informó que al menos 17 personas han desarrollado psicosis, lo que las hace incapaces de distinguir entre lo que es y no es realidad, después de interactuar con chatbots de IA generativos. No está claro si las interacciones de chatbot pueden desencadenar la psicosisdice el psiquiatra Søren Østergaard, pero las personas que ya experimentan síntomas como delirios o paranoia pueden ser particularmente susceptibles. Algunas compañías de IA han agregado salvaguardas a sus modelos para alejar las interacciones de temas sensibles o angustiantes, o aquellos que no están basados en la realidad.

Referencia: Preimpresión de psyarxiv (no revisado por pares)

Característica

Al capacitar un modelo de idioma grande (LLM) en los mensajes de texto y las grabaciones de voz de una persona, varias firmas de software están ofreciendo acceso a 'Griefbots' – Recreaciones digitales de una persona que permite a sus familiares comunicarse «con ellos» después de su muerte. Estos modelos de IA pueden ayudar a las personas a navegar su dolor, dicen los defensores. Otros piensan que los servicios basados en suscripción son explotadores y argumentan que podrían complicar el proceso de duelo normal. Hasta el momento, hay poca evidencia para respaldar cualquier punto de vista, lo que deja la decisión de usar el dolor en manos de los dolientes individuales.

Este artículo es parte de Perspectiva de la naturaleza: robótica e inteligencia artificialun suplemento editorialmente independiente producido con apoyo financiero del Instituto FII.

Para obtener las últimas noticias sobre inteligencia artificial directamente a su bandeja de entrada cada quince días, regístrese para Información de la naturaleza: AI y robótica – 100% escrito por humanos, por supuesto.