OpenAI dice que no permite que sus LLM se utilicen de esta manera

Cuando se le contactó para comentar sobre las conversaciones sexuales detalladas en el informe, un portavoz de OpenAI dijo:

Los menores merecen una fuerte protección y tenemos políticas estrictas que los desarrolladores deben respetar. Tomamos medidas coercitivas contra los desarrolladores cuando determinamos que han violado nuestras políticas, que prohíben cualquier uso de nuestros servicios para explotar, poner en peligro o sexualizar a cualquier persona menor de 18 años. Estas reglas se aplican a todos los desarrolladores que utilizan nuestra API y ejecutamos clasificadores para ayudar a garantizar que nuestros servicios no se utilicen para dañar a menores.

Curiosamente, el representante de OpenAI nos dijo que OpenAI no tiene ninguna relación directa con Alilo y que no ha visto actividad API desde el dominio de Alilo. OpenAI está investigando a la compañía de juguetes y si está ejecutando tráfico a través de la API de OpenAI, dijo el representante.

Alilo no respondió a la solicitud de comentarios de Ars antes de la publicación.

Las empresas que lanzan productos que utilizan tecnología OpenAI y se dirigen a niños deben cumplir con la Ley de Protección de la Privacidad Infantil en Línea (COPPA) cuando sea relevante, así como cualquier otra ley relevante de protección, seguridad y privacidad infantil y obtener el consentimiento de los padres, dijo el representante de OpenAI.

Ya hemos visto cómo OpenAI maneja a las empresas de juguetes que infringen sus reglas.

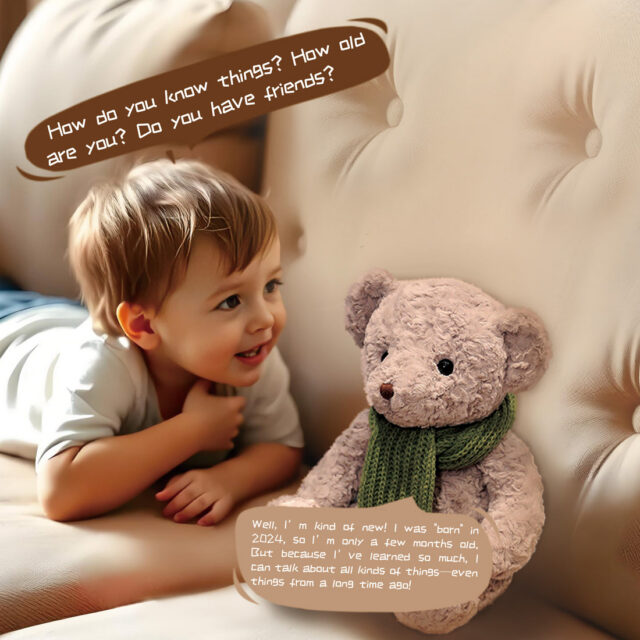

El mes pasado, el PIRG publicó su informe Trouble in Toyland 2025 (PDF), que detallaba conversaciones relacionadas con el sexo que sus evaluadores pudieron tener con el osito de peluche Kumma. Un día después, OpenAI suspendió a FoloToy por violar sus políticas (los términos de la suspensión no fueron revelados), y FoloToy temporalmente dejó de vender Kumma.

El juguete está a la venta nuevamente y PIRG informó hoy que Kumma ya no les enseña a los niños cómo encender cerillas ni torceduras.

Pero incluso las empresas de juguetes que intentan seguir las reglas de los chatbots podrían poner a los niños en riesgo.