Google acaba de dar un paso importante en la carrera armamentista de infraestructura de IA, elevando a Amin Vahdat a tecnólogo jefe de infraestructura de IA, un puesto recién creado que reporta directamente al CEO Sundar Pichai, según un memorando primero. reportado por Semafor y luego confirmado por TechCrunch. Es una señal de cuán crítico se ha vuelto este trabajo a medida que Google se lanza a $93 mil millones en gastos de capital para fines de 2025, una cifra que la empresa matriz Alphabet espera que sea mucho mayor el próximo año.

Vahdat no es nuevo en el juego. El científico informático, que tiene un doctorado de UC Berkeley y comenzó como pasante de investigación en Xerox PARC a principios de los años 90, ha estado construyendo silenciosamente la columna vertebral de la IA de Google durante los últimos 15 años. Antes de unirse a Google en 2010 como ingeniero y vicepresidente, fue profesor asociado en la Universidad de Duke y posteriormente profesor y presidente de SAIC en UC San Diego. Sus credenciales académicas son formidables, con lo que parece estar a su alrededor. 395 artículos publicados – y su investigación siempre se ha centrado en hacer que las computadoras funcionen de manera más eficiente a escala masiva.

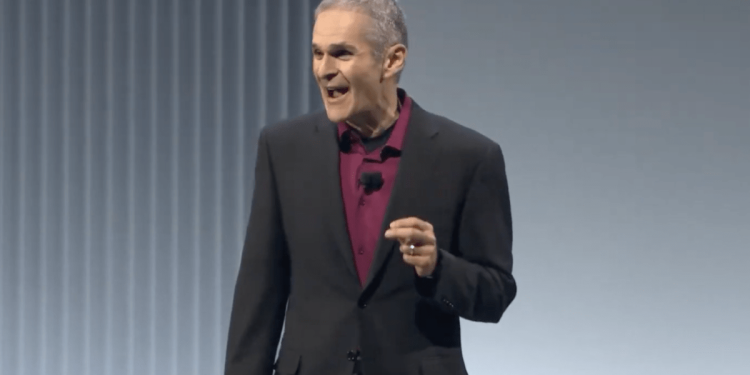

Vahdat ya mantiene un alto perfil en Google. Hace apenas ocho meses, en Google Cloud Next, subió al escenario para presentar la TPU de séptima generación de la compañía, llamada Ironwood, en su papel de vicepresidente y director general de aprendizaje automático, sistemas e inteligencia artificial en la nube. Las especificaciones que mencionó en el evento también fueron asombrosas: más de 9.000 chips por módulo que entregaban 42,5 exaflops de cómputo, más de 24 veces la potencia de la supercomputadora número uno del mundo en ese momento, dijo. «La demanda de computación de IA se ha multiplicado por 100 millones en sólo ocho años», dijo a la audiencia.

Detrás de escena, como señaló Semafor, Vahdat ha estado orquestando el trabajo poco glamoroso y esencial que mantiene competitivo a Google, incluidos esos chips TPU personalizados para entrenamiento e inferencia de IA que le dan a Google una ventaja sobre rivales como OpenAI, así como la red Júpiter, la red interna súper rápida que permite que todos sus servidores se comuniquen entre sí y muevan cantidades masivas de datos. (En un publicación de blog A fines del año pasado, Vahdat dijo que Júpiter ahora escala a 13 petabits por segundo, explicando que es suficiente ancho de banda para soportar teóricamente una videollamada para los 8 mil millones de personas en la Tierra simultáneamente).

Vahdat también ha estado profundamente involucrado en el desarrollo continuo del sistema de software Borg, el sistema de gestión de clústeres de Google que actúa como el cerebro que coordina todo el trabajo que ocurre en sus centros de datos. Y ha dicho que supervisó el desarrollo de Axion, las primeras CPU de uso general personalizadas basadas en Arm de Google diseñadas para centros de datos, que la empresa presentado el año pasado y sigue construyendo.

En resumen, Vahdat es fundamental para la historia de la IA de Google.

De hecho, en un mercado donde los mejores talentos de IA exigen una compensación astronómica y un reclutamiento constante, la decisión de Google de elevar a Vahdat a la alta dirección también puede tener que ver con la retención. Cuando has pasado 15 años convirtiendo a alguien en un eje de tu estrategia de IA, te aseguras de que se quede.

Evento tecnológico

san francisco

|

13-15 de octubre de 2026