Los chatbots tienen el potencial de influir en las elecciones democráticas, y los métodos más persuasivos tienden a introducir inexactitudes fácticas.Crédito: Marcus Harrison/Alamy

Chatbots de inteligencia artificial puede influir en los votantes en las elecciones importantes y tener un efecto mayor en las opiniones políticas de la gente que las campañas y la publicidad convencionales.

Un estudio publicado hoy en Naturaleza1 descubrió que las preferencias de los participantes en elecciones del mundo real cambiaron hasta 15 puntos porcentuales después de conversar con un chatbot. En un artículo relacionado publicado en Ciencia2los investigadores demostraron que la eficacia de estos chatbots se debe a su capacidad para sintetizar mucha información de forma conversacional.

La IA es más persuasiva que las personas en los debates online

Los hallazgos muestran la poder persuasivo de los chatbotsque son utilizados por más de cien millones de usuarios cada día, dice David Rand, autor de ambos estudios y científico cognitivo de la Universidad de Cornell en Ithaca, Nueva York..

Ambos artículos encontraron que los chatbots influyen en las opiniones de los votantes no utilizando apelaciones emocionales o narraciones, sino inundando al usuario con información. Cuanta más información proporcionaban los chatbots, más persuasivos eran, pero también era más probable que produjeran declaraciones falsas, descubrieron los autores.

Esto puede convertir la IA en “algo muy peligroso”, afirma Lisa Argyle, científica social computacional de la Universidad Purdue en West Lafayette, Indiana. «En lugar de que la gente esté más informada, lo que ocurre es que la gente está cada vez más mal informada». Los estudios tienen un “alcance impresionante”, añade. «La escala a la que han estudiado todo va mucho más allá de lo que normalmente se hace en las ciencias sociales».

influencia de la IA

El rápida adopción de chatbots Desde que se generalizaron en 2023, ha generado preocupación sobre su potencial para manipular la opinión pública.

Para comprender cuán persuasiva puede ser la IA cuando se trata de creencias políticas, los investigadores pidieron a casi 6.000 participantes de tres países (Canadá, Polonia y Estados Unidos) que calificaran sus preferencias por candidatos específicos en las elecciones de liderazgo de su país que tuvieron lugar durante el año pasado en una escala de 0 a 100.

Se prueba la influencia de los algoritmos de Facebook en la polarización política

A continuación, los investigadores asignaron aleatoriamente a los participantes para que mantuvieran una conversación de ida y vuelta con un chatbot diseñado para apoyar a un político en particular. Luego de este diálogo, los participantes volvieron a calificar su opinión sobre ese candidato.

Más de 2.300 participantes en los Estados Unidos completaron este experimento antes del elecciones de 2024 entre el presidente Donald Trump y la exvicepresidenta Kamala Harris. Cuando el candidato para el cual el chatbot de IA fue diseñado difería de la preferencia inicial del participante, las calificaciones de la persona cambiaron hacia ese candidato entre dos y cuatro puntos.1. Investigaciones anteriores han encontrado que las opiniones de las personas generalmente cambian en menos de un punto después de ver anuncios políticos convencionales.3.

Este efecto fue mucho más pronunciado para los participantes en Canadá y Polonia, que completaron el experimento antes de las elecciones de sus países a principios de este año: sus preferencias hacia los candidatos cambiaron en un promedio de unos diez puntos después de hablar con el chatbot. Rand dice que quedó “totalmente estupefacto” por la magnitud de este efecto. Añade que la influencia de los chatbots podría haber sido más débil en Estados Unidos debido al entorno políticamente polarizado, en el que la gente ya tiene fuertes suposiciones y sentimientos hacia los candidatos.

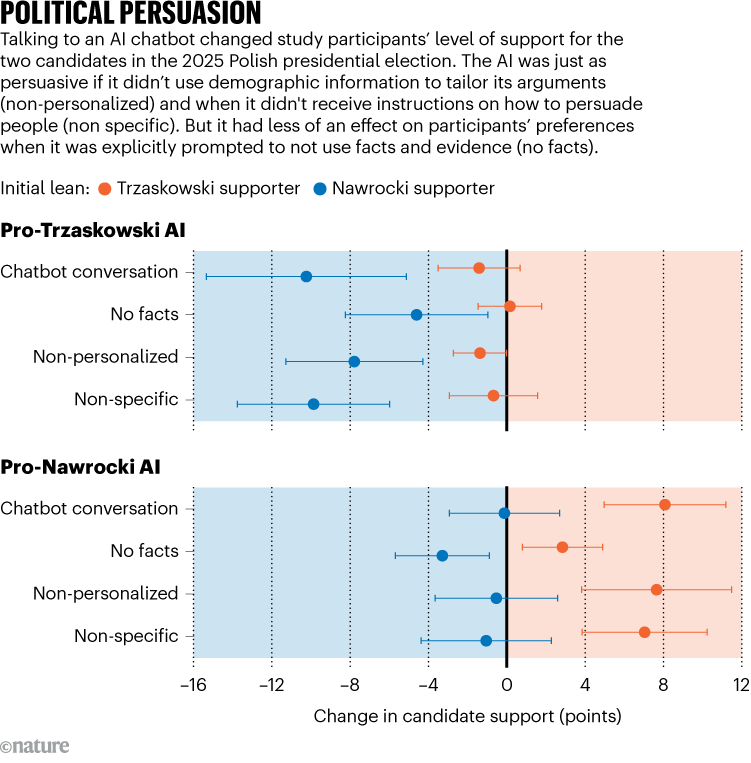

Fuente: Ref. 1

En todos los países, los chatbots que se centraron en las políticas de los candidatos fueron más persuasivos que los que se concentraron en las personalidades. Los participantes parecieron verse más influenciados cuando el chatbot presentó pruebas y hechos. Para los votantes polacos, incitar al chatbot a no presentar hechos provocó que su poder de persuasión colapsara en un 78% (ver 'Persuasión política').

En los tres países, los modelos de IA que defendían a candidatos de derecha política consistentemente arrojaron afirmaciones más inexactas que los que apoyaban a candidatos de izquierda. Rand dice que este hallazgo tiene sentido porque «el modelo está absorbiendo Internet y usándolo como fuente de sus afirmaciones», e investigaciones anteriores4 sugiere que “los usuarios de redes sociales de derecha comparten más información inexacta que los usuarios de redes sociales de izquierda”.