De cara al futuro, si las técnicas de eliminación de información reciben un mayor desarrollo en el futuro, las empresas de inteligencia artificial podrían algún día eliminar, digamos, contenido protegido por derechos de autor, información privada o texto memorizado dañino de una red neuronal sin destruir la capacidad del modelo para realizar tareas transformadoras. Sin embargo, dado que las redes neuronales almacenan información de formas distribuidas que aún no se comprenden completamente, por el momento los investigadores dicen que su método «no puede garantizar la eliminación completa de la información confidencial». Estos son los primeros pasos en una nueva dirección de investigación para la IA.

Viajando por el paisaje neuronal

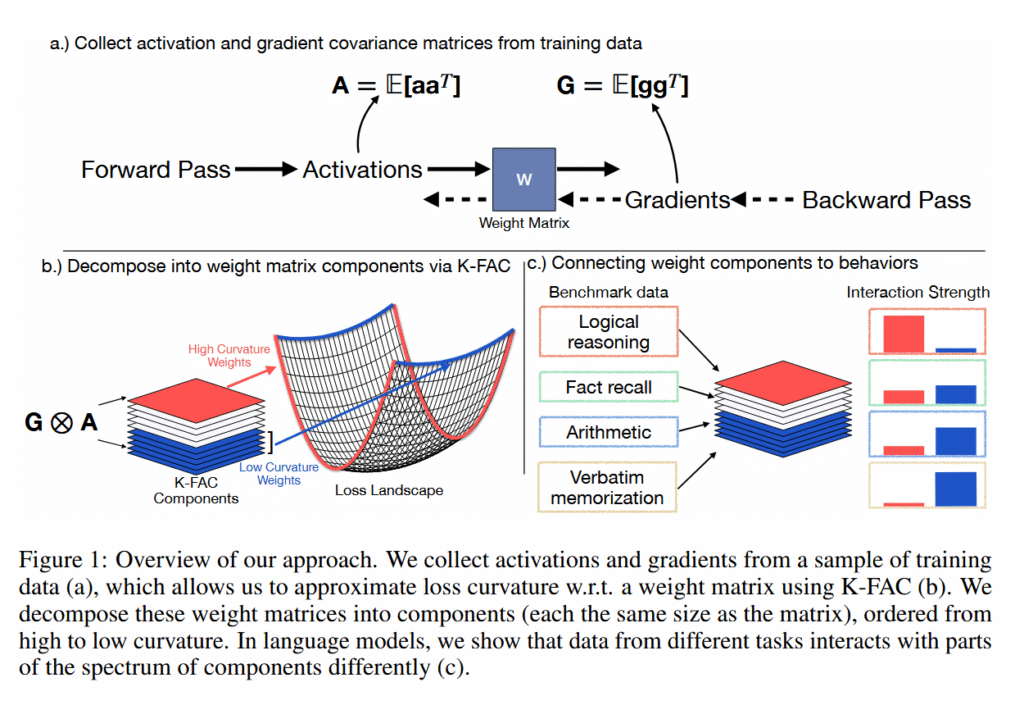

Para comprender cómo los investigadores de Goodfire distinguieron la memorización del razonamiento en estas redes neuronales, es útil conocer un concepto en IA llamado «panorama de pérdidas». El «panorama de pérdidas» es una forma de visualizar qué tan incorrectas o correctas son las predicciones de un modelo de IA a medida que se ajustan sus configuraciones internas (que se denominan «ponderaciones»).

Imagine que está ajustando una máquina compleja con millones de diales. La “pérdida” mide la cantidad de errores que comete la máquina. Una pérdida alta significa muchos errores, una pérdida baja significa pocos errores. El “paisaje” es lo que vería si pudiera trazar la tasa de error para cada combinación posible de configuraciones de dial.

Durante el entrenamiento, los modelos de IA esencialmente «ruedan cuesta abajo» en este paisaje (descenso de gradiente), ajustando sus pesos para encontrar los valles donde cometen la menor cantidad de errores. Este proceso proporciona resultados del modelo de IA, como respuestas a preguntas.

Los investigadores analizaron la «curvatura» de los paisajes de pérdida de modelos de lenguaje de IA particulares, midiendo qué tan sensible es el rendimiento del modelo a pequeños cambios en diferentes pesos de la red neuronal. Los picos y valles pronunciados representan una curvatura alta (donde pequeños cambios causan grandes efectos), mientras que las llanuras representan una curvatura baja (donde los cambios tienen un impacto mínimo).

Usando una técnica llamada K-FAC (Curvatura aproximada factorizada por Kronecker), descubrieron que los datos memorizados individuales crean picos agudos en este paisaje, pero debido a que cada elemento memorizado aumenta en una dirección diferente, cuando se promedian juntos crean un perfil plano. Mientras tanto, las capacidades de razonamiento de las que dependen muchas entradas diferentes mantienen curvas moderadas y consistentes en todo el paisaje, como colinas que mantienen aproximadamente la misma forma independientemente de la dirección desde la que te acerques a ellas.