AbiertoAI anunciado hoy que está pausando videos de Martin Luther King Jr. generados por IA en su Aplicación Soratras intensas críticas por contenido deepfake “irrespetuoso” que presenta al ícono de los derechos civiles.

Los videos de MLK Jr. han incluido de todo, desde hablar sobre soñar con galletas con trozos de chocolate y Sam Altman hasta generaciones de videos mucho más siniestros.

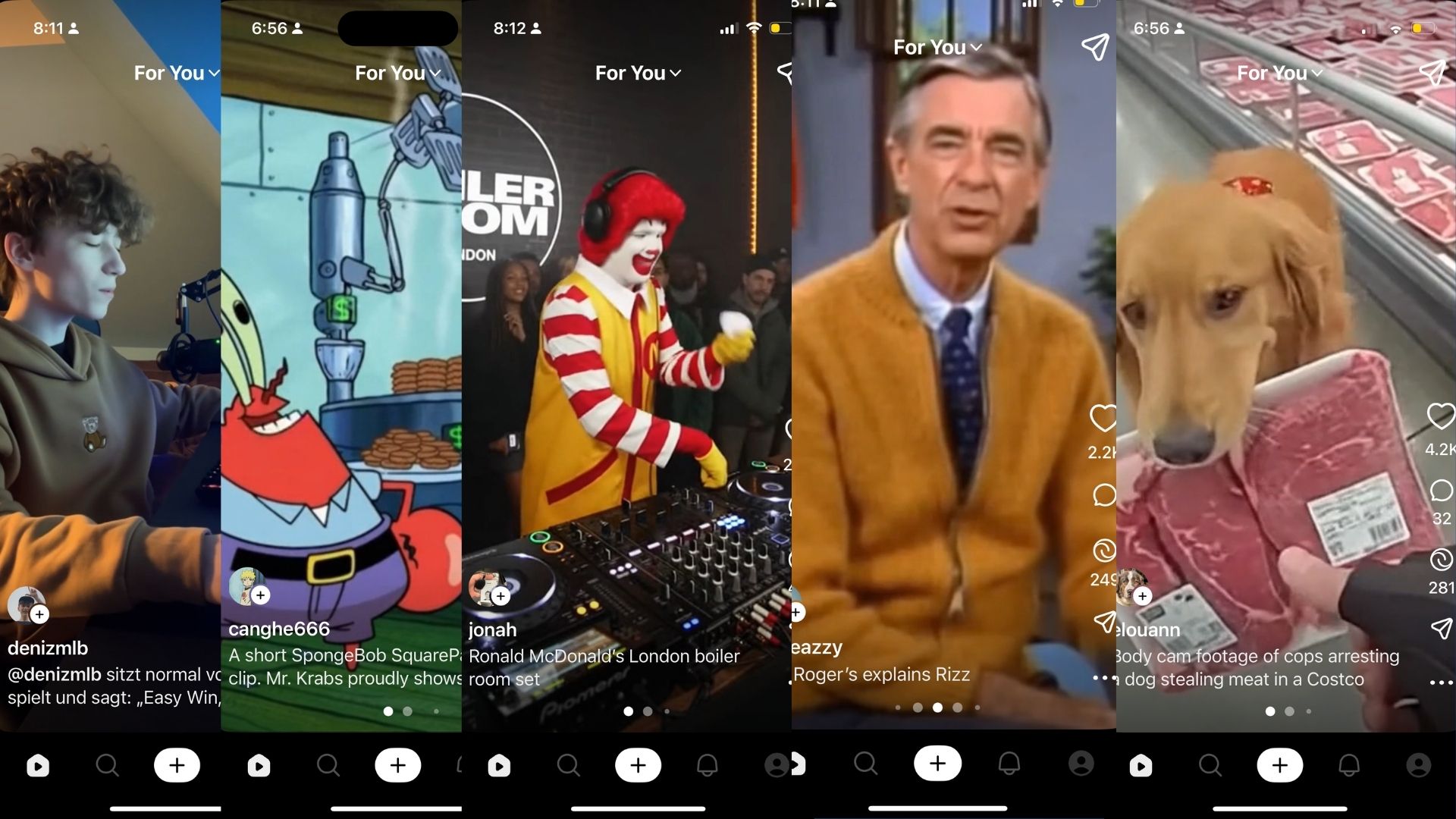

Si bien la medida se presenta como una concesión al patrimonio de King, señala tensiones más profundas en la forma en que las plataformas de inteligencia artificial navegan por la historia, el consentimiento y la ética de la resurrección de figuras públicas. Michael Jackson, Kobe Bryant y JFK están entre los fallecidos e irrespetuosos Vídeos que circulan actualmente.

OpenAI está retrocediendo

OpenAI está haciendo lo que debería haber hecho desde el principio: no permitir que figuras públicas fallecidas sean utilizadas en Vídeos generados por IA. Desde el lanzamiento de Sora, los usuarios publicaron videos de IA con impactantes distorsiones del Dr. King entre otras figuras prominentes, incluidas representaciones que su familia y sus seguidores calificaron de ofensivas y degradantes.

Bernice A. King, hija de Martin Luther King Jr., exigió públicamente a Instagram los videos generados se detienen, lo que provocó una declaración conjunta con OpenAI sobre barreras de seguridad más estrictas y mecanismos de exclusión voluntaria para las propiedades.

OpenAI enmarcó la decisión como un equilibrio entre la libertad de expresión y el respeto al legado y el control: la compañía dijo que las figuras públicas (y sus familias) deberían tener voz y voto sobre cómo se utiliza su imagen en AI medios de comunicación.

La frontera salvaje de la IA

Las herramientas de inteligencia artificial como Sora permiten a los usuarios imaginar o hacerse pasar por íconos culturales desaparecidos hace mucho tiempo, pero la ética de esto rápidamente se vuelve turbia. ¿Es homenaje, sátira o profanación? La pausa resalta cuán crudo y sin resolver es ese debate.

Incluso antes del lanzamiento de Sora 2, durante una sesión informativa con OpenAI que incluía a Sam Altman, otros periodistas y yo cuestionamos las posibilidades negativas de brindar a los usuarios herramientas de IA tan poderosas. Sin embargo, fue necesaria una reacción pública para lograr que OpenAI hiciera algún tipo de ajuste.

A diferencia de la ley de derechos de autor, la ley estadounidense no protege universalmente cómo se utilizan las imágenes de las personas fallecidas, aunque unos pocos estados reconocen derechos de publicidad post mortem.

La política de “exclusión voluntaria de propiedades” de OpenAI no garantiza mucho hasta que los tribunales o los estados definan límites más estrictos. Algunos expertos legales consideran que su enfoque es fragmentario y reactivo.

OpenAI se está poniendo al día

OpenAI originalmente permitía representaciones amplias de personas fallecidas de forma predeterminada, a menos que las propiedades se opusieran. Esta nueva política se enmarca como parte de un cambio, pero muchos creen que la empresa todavía está tratando de ponerse al día. Los críticos señalan que prohibir a MLK podría ser una medida excepcional; controlar el resto de la cámara de eco de la IA es un problema mucho más difícil.

Cuando las películas, los libros de texto y los archivos ya median en la forma en que recordamos la historia, Falsificaciones profundas de IA corre el riesgo de convertirse en otra lente; uno que es inexplicable. Si los usuarios pueden «reimaginar» a King diciendo o haciendo cualquier cosa, ¿qué detendrá la distorsión durante décadas? Es evidente que estamos en territorio inexplorado.

Debido a la reacción violenta, los herederos o representantes de otras figuras históricas pueden solicitar la exclusión voluntaria de ser incluidos en la generación de videos de Sora.

Si bien OpenAI reconoció fuertes intereses en materia de libertad de expresión, decidió pausar primero las representaciones de MLK. Pero quizás esto sea sólo un caso de prueba.

Pensamientos finales

Vale la pena considerar por qué y cómo utilizamos herramientas de inteligencia artificial tan poderosas. Abre preguntas sobre cómo OpenAI manejará casos posteriores. ¿Bloqueará la empresa de forma proactiva determinadas cifras? Con miles de millones de videos generados, ¿cómo pueden controlarlo todo? ¿La respuesta es crear una base de datos de imágenes no permitidas o deberían confiar en solicitudes manuales?

Si está utilizando Sora o herramientas de vídeo de IA similares, esta pausa es una señal de advertencia. Espere más limitaciones sobre quién (o qué) puede dar vida en los medios generados por IA.

También abre una ventana a una comprensión más amplia de que la IA tiene que ver con la responsabilidad. Así como con los motores potentes no podemos conducir por toda la carretera o sin reglas, la potencia de la IA también debe gestionarse de alguna manera.

Desde las imágenes de celebridades hasta la memoria histórica, no tengo dudas de que las plataformas serán cada vez más juzgadas por cómo gestionan el espacio entre la creatividad y el consentimiento.

Seguir La guía de Tom en Google News y agréganos como fuente preferida para recibir nuestras noticias, análisis y reseñas actualizados en sus feeds. ¡Asegúrate de hacer clic en el botón Seguir!

Más de la guía de Tom

Volver a portátiles